欧洲刑警组织警告:ChatGPT或被用来实施犯罪

来源:参考消息网

据德新社报道,欧洲刑警组织当地时间3月27日说,ChatGPT(聊天生成预训练转换器)等人工智能聊天机器人有阴暗面,很可能被犯罪分子滥用。

欧洲刑警组织说,针对公众给予ChatGPT越来越多的关注,该组织的创新实验室已经组织了多次研讨会,探讨犯罪分子可以怎样滥用大型语言模式和协助调查人员展开工作。

报道称,这个总部设在海牙的机构说,在许多值得关切的领域中,该组织正集中关注三个犯罪领域:欺诈、社会工程和虚假信息以及网络犯罪。

就第一个领域而言,该组织说:ChatGPT撰写高度逼真文章的能力使它成为网络钓鱼的有用工具。欧洲刑警组织说,它模拟言语模式的能力可以用于模仿特定个人或组织的语言风格。

报道称,在虚假信息方面,该组织说,ChatGPT擅于快速和大量制造听起来真实的文章,这使它成为宣传和制造虚假信息等方面的理想模型。

在网络犯罪方面,欧洲刑警组织指出,ChatGPT可以用许多编程语言制造代码。该组织说:对一个没有多少技术知识的潜在罪犯来说,这是一个制造恶意代码的极其有用的资源。

(编译/杨新鹏)

(来源:参考消息网)

Lightning AI的首席技术官Luca Antiga预计,2023年,LLM的投资将激增。Lightning AI开发了一个训练和部署AI的平台。

像GPT-3和BERT这样的LLM通过以触发模式来解决特定问题(如数学测验)的方式输入文本,显示出执行复杂任务的能力。Antiga说。LLM被认为是‘大型’的,因为无法将其加载到单个设备上,并且在训练模型时经常会遇到相应的困难。2023年,我预计寻求资金或将现有资金重新分配到专门用于创建和训练单个LLM的预算中的初创公司和老牌企业的数量将大幅增加。

商业分析软件和服务提供商ThoughtSpot的联合创始人兼首席技术官Amit Prakash表示,得益于LLM,狭义人工智能将得到更广泛的应用。

Prakash说:到目前为止,商业环境中的人工智能要么被用于预测任务(预测、欺诈、点击、转换),要么被用于自动化低技能任务。大多数应用程序的领域都非常狭窄,通常需要大量的功能工程才能正确实现,而且只有在大规模情况下才有意义。

GPT-3等LLM和DALL-E等生成模型正在改变游戏规则,我们预计人工智能将在未来几年触及商业的几乎每一个方面。人工智能模型可以用来吸收大量知识,并在任何时候战略性地部署它,只要它能改善结果,从回答特定问题到通过自动化来帮助人类完成高度创造性的任务。

人们担心LLM会使作家过时。根据医疗AI公司AKASA的首席技术官兼联合创始人Varun Ganapathi的说法,LLM实际上会帮助人们更有创造力。

Ganapathi表示,我们很可能会看到更多的解决方案,比如GitHub Co-Pilot,LLM能够以有意义的方式帮助人们。这些工具并不能解决所有问题,但它们将有助于解决最初的写作障碍。当你盯着空白页时,通常很难开始。但如果你能描述提示或问题,并且模型输出了一些东西,它可能会给你一个好的启示,并向你展示一些你可以使用的东西,即使它不完全符合你的需要。提示工程(即使用正确的起始文本指导模型)将成为一种使用自然语言编写程序的新方式。

2023年大型语言模型:围绕ChatGPT的一场讨论

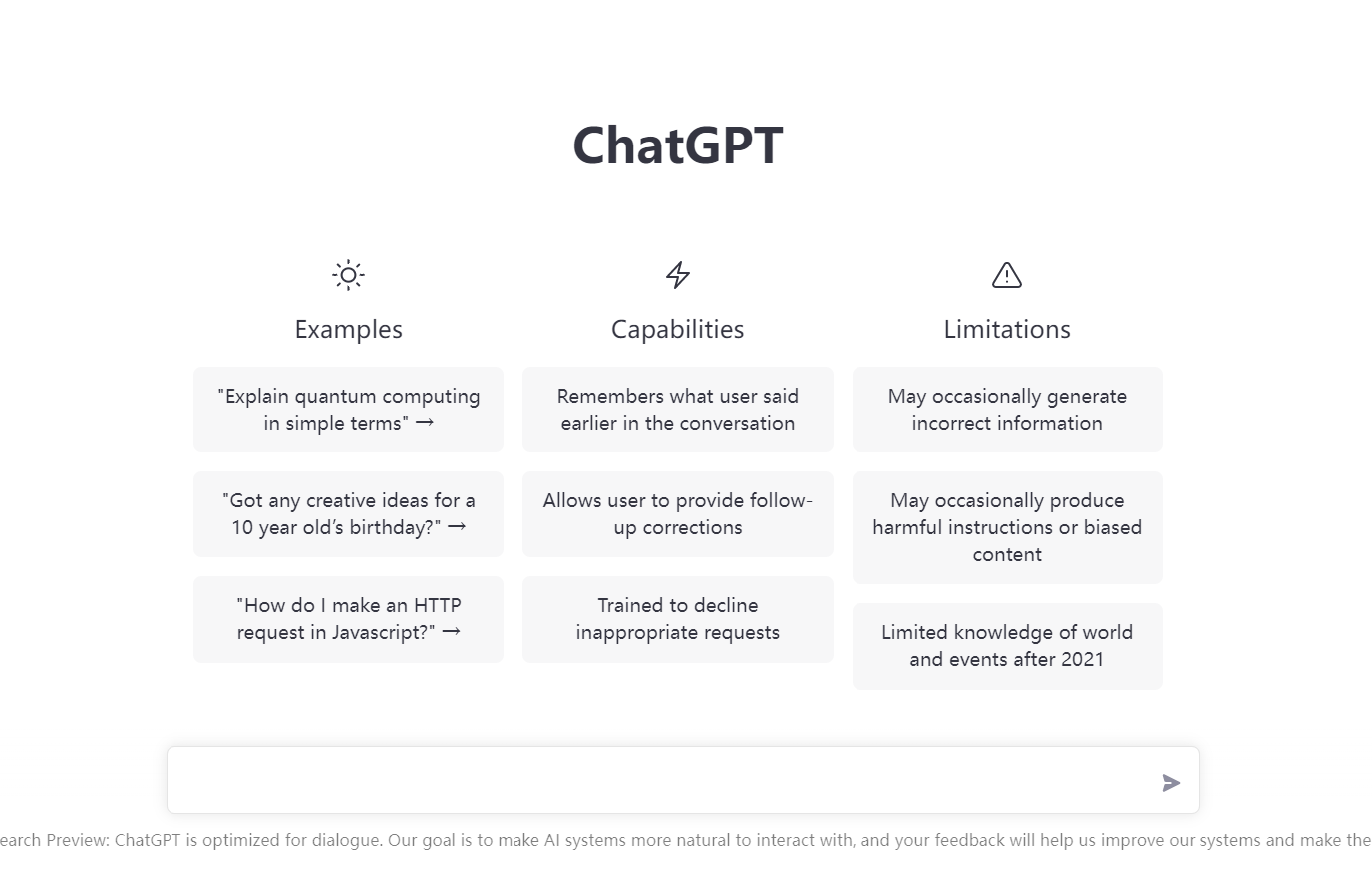

不可否认,ChatGPT引起了全世界的关注。但是,ChatGPT作为大型语言模型(LLM)的成员之一,它是否具有在2023年成为商业变革力量的持久力?我们看看预